RNGD 是一款用于高级语言模型以及生成式和代理人工智能的数据中心推理加速器。

中国存储网消息,FuriosaAI正式大量发售RNGD,官方博客称:随着我们的合作伙伴台积电和华硕已交付了首批4000台,我们的高性能AI芯片可立即面向全球企业客户提供,既有独立PCIe卡,也有交钥匙服务器。

Furiosa联合创始人兼首席执行官白秋表示:“将第一原理架构转化为量产硅芯片,是少数AI芯片初创公司能做到的。“随着RNGD现已发售,我们赋予企业大规模运行最先进的大型语言模型和代理人工智能的能力,而无需承担传统解决方案带来的巨大能源和基础设施损失。 我们将在此基础上继续努力,积极推进,实现让高性能人工智能计算真正可持续的使命,惠及每一家企业。”

高性能,无需数据中心改造

现代AI模型需要大量计算,但绝大多数企业数据中心采用风冷,且每机架功率上限为15kW。耗电量大的老旧GPU通常每颗芯片消耗600W+,需要昂贵且耗时的基础设施升级。GPU数据中心在获取、交付和支付大量电力以维持运营方面面临着巨大的额外障碍。行业需要一种高性能的替代方案,能在你今天的机架中发挥作用。

RNGD 是一款用于高级语言模型以及生成式和代理人工智能的数据中心推理加速器。它兼具性能(512 INT8 TFLOPS)和突破性的能源效率,这对于克服基础设施瓶颈和降低总拥有成本至关重要。

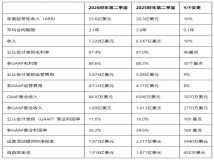

FuriosaAI稳步推进硬件稳定和软件栈优化,带来了现实里程碑,如LG AI Research采用EXAONE,以及去年下半年与OpenAI合作的gpt-oss模型公开演示。

与此同时,公司通过与台积电、SK海力士及其他全球科技领头企业的紧密合作,建立了稳定的制造和供应链。

由于我们的架构专为人工智能设计,RNGD在标准环境中的计算密度(每机架吞吐量)比基于H100的系统高出3.5倍。RNGD现已提供两种形式:

RNGD PCIe 卡:一款可直接加速的加速器,在严格的 180W TDP 下实现前沿型号性能 NXT RNGD 服务器:即插即用的 4U 机架式服务器,内置 8 张 RNGD 卡。由于系统仅需3kW,你可以在一个标准空冷机架中堆放五台NXT RNGD服务器,每个机架可实现20 petaFLOPS(INT8)

RNGD由功能齐全的SDK支持,提供先进的优化技术,如芯片间张量并行,并支持Qwen 2和Qwen 2.5等流行模型。Furiosa SDK 支持 torch.compile,是 vLLM 的替代工具,并兼容 OpenAI API,使开发者只需对现有代码进行最小修改即可快速作。拥抱面中心的预编译工件现在支持最高32K令牌的上下文长度,使应用更复杂且具备上下文感知能力。

硅在生产中已验证 LG AI Research通过其EXAONE模型进行严格验证,确认RNGD每瓦性能比同类GPU高出2.25倍。

我们优化了OpenAI的120B参数GPT-OSS模型,使其仅能在两张RNGD卡上运行,证明我们能用通常所需硬件的一小部分处理庞大的参数数量。

在GPU上运行先进AI的成本和基础设施挑战正成为整个行业的瓶颈。但现在任何数据中心都有高性能推理的替代解决方案。RNGD正在发售,可扩展,现在就可以部署了。

声明: 此文观点不代表本站立场;转载须要保留原文链接;版权疑问请联系我们。